Μάθετε Τον Αριθμό Του Αγγέλου Σας

Δεοντολογία τεχνητής νοημοσύνης: Πώς οι έμποροι πρέπει να αγκαλιάσουν την καινοτομία με υπευθυνότητα

Η τεχνητή νοημοσύνη (AI) δεν είναι απλώς ένα φαινόμενο επιστημονικής φαντασίας που μετατράπηκε στην πραγματικότητα - είναι ένα τεχνολογικό στήριγμα, που αναπτύχθηκε εδώ και δεκαετίες ακριβώς κάτω από τη μύτη μας. Η τεχνητή νοημοσύνη έχει πραγματοποιήσει όνειρα για αυξημένη απόδοση, με πολλές μάρκες να έχουν ήδη αξιοποιήσει Μάρκετινγκ AI κατά τη διάρκεια των τελευταίων ετών.

Αν και έχει προκαλέσει ενθουσιασμό και ενθουσιασμό, υπάρχουν ανησυχίες σχετικά με την ηθική της τεχνητής νοημοσύνης. Όπως πολλές καινοτομίες, το όραμα της βιομηχανίας τεχνολογίας για το μετασύμπαν είχε τρομερές ομοιότητες με μέσα όπως το Black Mirror και το Snow Crash . Και με έργα όπως το Paraable of the Sower, the Machine and I, Robot εντός του πολιτιστικού zeitgeist, είναι κατανοητό γιατί οι θαυμαστές της επιστημονικής φαντασίας, οι ερευνητές και οι τεχνολόγοι προειδοποιούν για τους κινδύνους από την αγνόηση της ηθικής της τεχνητής νοημοσύνης.

Σε αυτό το άρθρο θα ορίσουμε τι είναι η ηθική της τεχνητής νοημοσύνης, γιατί πρέπει να ανησυχούν οι επωνυμίες και τα κορυφαία ηθικά ζητήματα που αντιμετωπίζουν οι έμποροι, όπως η ασφάλεια της εργασίας, η παραπληροφόρηση και η αλγοριθμική προκατάληψη. Θα μοιραστούμε επίσης πέντε βήματα για να σας βοηθήσουμε να διατηρήσετε ηθικές πρακτικές τεχνητής νοημοσύνης εντός των ομάδων και σε ολόκληρο τον οργανισμό.

Τι είναι η ηθική της τεχνητής νοημοσύνης;

Η ηθική της τεχνητής νοημοσύνης είναι ένα σύστημα ηθικών αρχών και επαγγελματικών πρακτικών που χρησιμοποιούνται για την υπεύθυνη ενημέρωση για την ανάπτυξη και τα αποτελέσματα της τεχνολογίας τεχνητής νοημοσύνης. Αναφέρεται επίσης στη μελέτη του τρόπου βελτιστοποίησης του αντίκτυπου και μείωσης των κινδύνων ή/και των συνεπειών της τεχνητής νοημοσύνης.

400 αριθμός αγγέλου

Κορυφαίες εταιρείες τεχνολογίας, κυβερνητικές οντότητες όπως τα Ηνωμένα Έθνη και κοινότητες έρευνας και επιστήμης δεδομένων έχουν εργαστεί για να διαμορφώσουν και να δημοσιεύσουν κατευθυντήριες γραμμές για την αντιμετώπιση ηθικών ζητημάτων. Για παράδειγμα, ο Εκπαιδευτικός, Επιστημονικός και Πολιτιστικός Οργανισμός των Ηνωμένων Εθνών (UNESCO) δημοσίευσε το πρώτο παγκόσμιο πρότυπο για την ηθική της τεχνητής νοημοσύνης τον Νοέμβριο του 2021: Η Σύσταση για την Ηθική της Τεχνητής Νοημοσύνης .

Υπάρχουν ορισμένοι κανονισμοί για την τεχνητή νοημοσύνη σε εθνικό και τοπικό επίπεδο, αλλά καθώς η τεχνητή νοημοσύνη και άλλες αναδυόμενες τεχνολογίες αναπτύσσονται, οι επιχειρήσεις θα πρέπει να περιμένουν περισσότερες κυβερνητικές ρυθμίσεις. Καθώς η τεχνητή νοημοσύνη ενσωματώνεται περαιτέρω στη ζωή μας, η ηθική της τεχνητής νοημοσύνης γίνεται κρίσιμο μέρος του ψηφιακού γραμματισμού.

Γιατί η ηθική της τεχνητής νοημοσύνης έχει σημασία

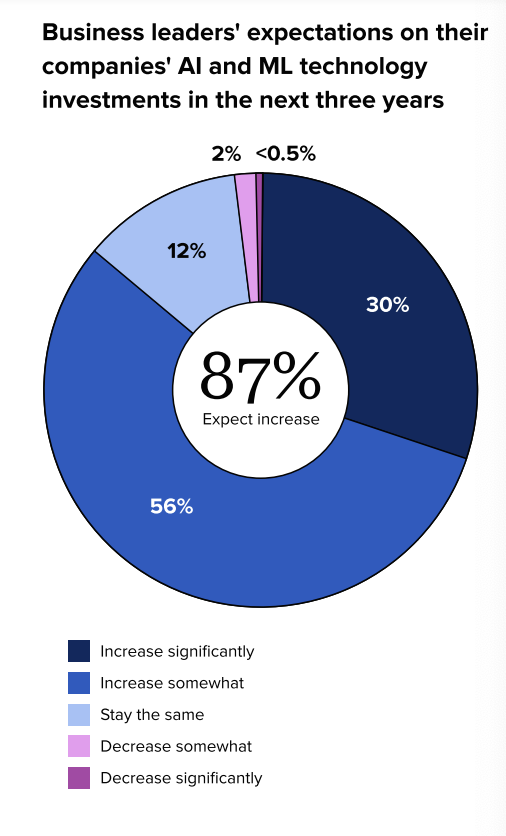

Οι εταιρείες επενδύουν ήδη στην τεχνητή νοημοσύνη, αλλά η δυσκολία είναι να εξασφαλίσουν υπεύθυνη χρήση.

Σύμφωνα με Η κατάσταση των μέσων κοινωνικής δικτύωσης για το 2023: AI και Data Take Center Stage έκθεση, οι ηγέτες των επιχειρήσεων αναμένουν αυξημένες επενδύσεις στην τεχνητή νοημοσύνη τα επόμενα χρόνια. Η έκθεσή μας διαπίστωσε επίσης ότι το 98% των ηγετών επιχειρήσεων συμφωνεί ότι οι εταιρείες πρέπει να κατανοήσουν καλύτερα τις δυνατότητες της τεχνολογίας AI και μηχανικής μάθησης (ML) για μακροπρόθεσμη επιτυχία.

Ενώ η τεχνητή νοημοσύνη μπορεί να βελτιώσει την απόδοση, να ενισχύσει την αποδοτικότητα και να δημιουργήσει θετικά επιχειρηματικά αποτελέσματα, οι επωνυμίες αντιμετωπίζουν επίσης απρόβλεπτες συνέπειες από την εφαρμογή της. Αυτό μπορεί να οφείλεται σε έλλειψη έρευνας ή μεροληπτικά σύνολα δεδομένων, μεταξύ άλλων λόγων. Η κακή χρήση της τεχνητής νοημοσύνης ή η παραμέληση ηθικών ανησυχιών μπορεί να οδηγήσει σε ζημία στη φήμη της επωνυμίας, σε αποτυχίες προϊόντος, σε δικαστικές διαφορές και σε ρυθμιστικά ζητήματα.

Το πρώτο βήμα για την τήρηση των δεοντολογικών προτύπων σε όλες τις ομάδες εντός του οργανισμού σας ξεκινά με την κατανόηση των προβλημάτων που αντιμετωπίζουν οι έμποροι, ώστε να μπορείτε να διαμορφώσετε ένα σχέδιο για τον μετριασμό αυτών των επιχειρηματικών κινδύνων και την προστασία της επωνυμίας σας.

Ποια ζητήματα ηθικής τεχνητής νοημοσύνης είναι στο επίκεντρο των εμπόρων

Υπάρχουν διάφορες ηθικές ανησυχίες για την τεχνητή νοημοσύνη στον κλάδο της τεχνολογίας, συμπεριλαμβανομένων, ενδεικτικά, των εξής:

- Δημιουργία ψευδούς περιεχομένου

- Επεξηγησιμότητα

- Κοινωνικός αντίκτυπος

- Κατάχρηση τεχνολογίας

- Προκατάληψη

- Ευθύνη δεδομένων και απόρρητο

- Δικαιοσύνη

- Ευρωστία

- Διαφάνεια

- Περιβαλλοντική βιωσιμότητα

- Ποικιλομορφία και συμπερίληψη

- Ηθική δράση και ευθυγράμμιση αξίας

- Εμπιστοσύνη και υπευθυνότητα

Ορισμένοι πιστεύουν ότι η τεχνητή νοημοσύνη μπορεί να βοηθήσει στη δημιουργία περισσότερων τεχνολογιών, συστημάτων και υπηρεσιών χωρίς αποκλεισμούς που μπορούν να εξυπηρετήσουν διαφορετικούς πληθυσμούς. Το κλειδί είναι να θεσπιστούν ηθικά πλαίσια, κανονισμοί και μηχανισμοί για να διασφαλιστεί η υπεύθυνη χρήση.

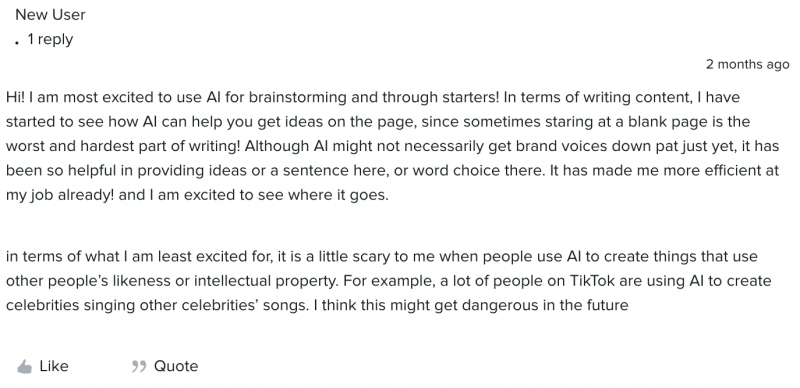

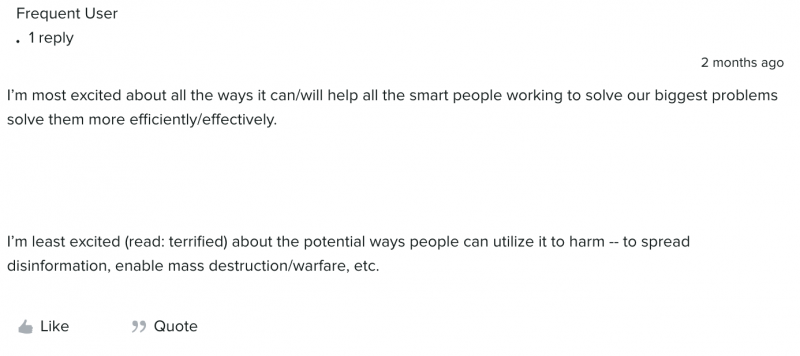

Μέλος του το Δενδροκομείο , το κοινοτικό φόρουμ του Sprout, σημείωσε ότι η τεχνητή νοημοσύνη έχει τη δυνατότητα να προωθήσει τη συμπερίληψη και να μειώσει τις προκαταλήψεις/διακρίσεις διασφαλίζοντας δίκαιες, αμερόληπτες διαδικασίες λήψης αποφάσεων. Με την αντιμετώπιση ζητημάτων όπως η αλγοριθμική μεροληψία στην ανάπτυξη της τεχνητής νοημοσύνης, θα μπορούσε να είναι δυνατό να διαμορφωθεί ένα μέλλον όπου η τεχνητή νοημοσύνη είναι μια θετική δύναμη αλλαγής.

Μαζί με τη δυνατότητα για θετική αλλαγή, υπάρχουν επίσης ευκαιρίες για κακή χρήση ή ανήθικη χρήση της τεχνητής νοημοσύνης καθώς γίνεται πιο ισχυρή. Η κοινότητά μας συζήτησε διάφορους κινδύνους, όπως παραβίαση της ιδιωτικής ζωής, χειραγώγηση της κοινής γνώμης και αυτόνομα όπλα.

Σχόλια σαν αυτά απλώς χαράζουν την επιφάνεια των ηθικών ανησυχιών σε όλους τους κλάδους, αλλά τα κορυφαία ζητήματα για τους επαγγελματίες του μάρκετινγκ περιλαμβάνουν: ασφάλεια εργασίας, ιδιωτικότητα, μεροληψία και διακρίσεις, παραπληροφόρηση και παραπληροφόρηση και ζητήματα πνευματικής ιδιοκτησίας/πνευματικών δικαιωμάτων, τα οποία θα αναλύσουμε λεπτομερώς στο επόμενη ενότητα.

Επιπτώσεις στις θέσεις εργασίας και μετατόπιση θέσεων εργασίας

Τα ρομπότ που διασφαλίζουν την παγκόσμια κυριαρχία είναι το λιγότερο από τις ανησυχίες μας — τουλάχιστον προς το παρόν.

έννοια του 1919

Και αυτό γιατί οι ερευνητές και οι ειδικοί δεν απειλούνται από μοναδικότητα της τεχνολογίας , ή την ιδέα ότι η τεχνητή νοημοσύνη θα ξεπεράσει την ανθρώπινη νοημοσύνη και θα αναπαράγει χαρακτηριστικά όπως τις κοινωνικές δεξιότητες. Γνωρίζουν τους περιορισμούς της τεχνητής νοημοσύνης και τις πιθανές συνέπειες της αντικατάστασης εργασίας.

Ο στόχος της έρευνας και επενδύοντας στην τεχνητή νοημοσύνη δεν είναι για να αντικαταστήσει τους ανθρώπους - είναι για να μας βοηθήσει να εξοικονομήσουμε χρόνο και προσπάθεια για να κάνουμε πιο αποτελεσματικά πράγματα. Ο Διευθυντής Κοινωνικών Μέσων και Συνεργασιών της Flock Freight, Bob Wolfley μοιράστηκε μια μεγάλη αναλογία για το AI : «Το AI είναι σαν το πλυντήριο πιάτων ή το πλυντήριο ρούχων στα σπίτια μας. Σκεφτείτε όλο τον χρόνο που εξοικονομείτε, μην πλένετε πιάτα ή ρούχα στο χέρι.'

Στη σειρά μας Unread, τα μέλη της ομάδας μάρκετινγκ και δημιουργικών του Sprout συζήτησαν πώς χρησιμοποιούν αυτήν τη στιγμή την τεχνητή νοημοσύνη, από την επιδίωξη εξατομικευμένων αγορών έως τη χρήση λειτουργιών όπως το ViralPost® για να βοηθήσουν στον προγραμματισμό αναρτήσεων στα κοινωνικά δίκτυα. Παρακολουθήστε το παρακάτω βίντεο για να ακούσετε τις καυτές απόψεις τους για τα οφέλη και τους φόβους της τεχνητής νοημοσύνης, συμπεριλαμβανομένης της αντικατάστασης εργασίας:

Ανησυχίες για το απόρρητο

Οι ανησυχίες σχετικά με το απόρρητο των δεδομένων, την προστασία και την ασφάλεια είναι στο επίκεντρο των επωνυμιών. Οι επενδύσεις σε θέματα ασφάλειας αποτελούν αυξανόμενη προτεραιότητα για τις επιχειρήσεις, καθώς επιδιώκουν να αποφύγουν τυχόν ευκαιρίες για παρακολούθηση, πειρατεία και κυβερνοεπιθέσεις. Καθώς η εξατομίκευση γίνεται πιο δημοφιλής, οι επωνυμίες εφαρμόζουν βέλτιστες πρακτικές για τη συλλογή, την αποθήκευση και την ανάλυση δεδομένων για την προστασία των πελατών και των οργανισμών.

Αλγοριθμική προκατάληψη και διάκριση

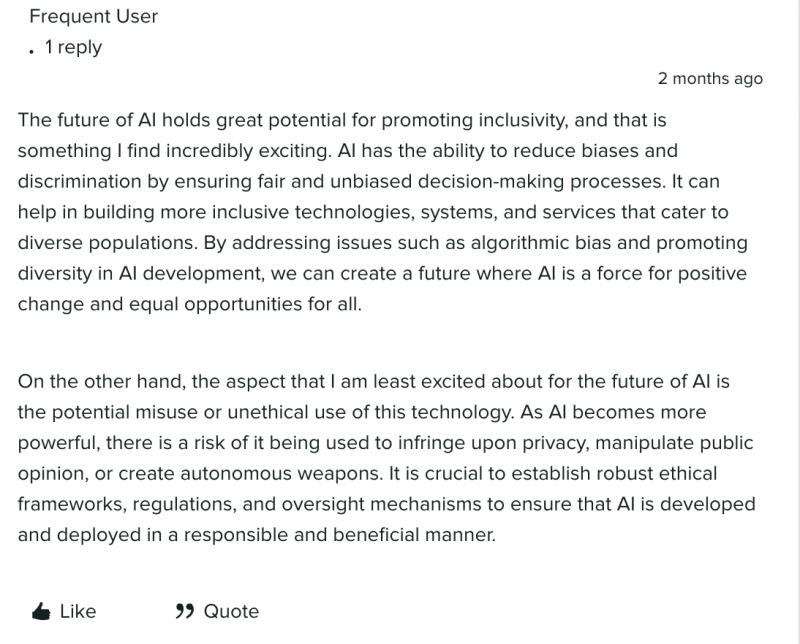

Δεδομένου ότι μαθαίνει από δεδομένα, μια κακώς κατασκευασμένη ή εκπαιδευμένη τεχνητή νοημοσύνη μπορεί να επιδείξει μεροληψία έναντι υποεκπροσωπούμενων υποσυνόλων δεδομένων. Υπήρξαν πολλές μεγάλες περιπτώσεις μεροληψίας με έργα τέχνης που δημιουργούνται από AI, chatbots, λογισμικό αναγνώρισης προσώπου, αλγόριθμους και εργαλεία AI για πρακτικές πρόσληψης .

Για παράδειγμα, αρκετοί χρήστες του TikTok και του Twitter [που μετονομάστηκαν σε X από τον Ιούλιο του 2023] φώναξαν ένα νήμα με τη «#SouthSudan Barbie» στολισμένη με όπλα, ένα αρνητικό στερεότυπο που σχετίζεται με μια περιοχή που αντιμετωπίζει κοινωνικοπολιτικά ζητήματα όπως η γενοκτονία και οι προσφυγικές κρίσεις .

Καθώς η προκατάληψη εισέρχεται σε ακόμη χαμηλότερα πονταρίσματα, η τεχνητή νοημοσύνη χρησιμοποιεί περιπτώσεις όπως αυτή, το ερώτημα είναι πώς εργαζόμαστε ενάντια στην προκατάληψη και τις διακρίσεις όταν τα σύνολα δεδομένων εκπαίδευσης μπορούν να προσφερθούν σε μεροληψία;

Παραπληροφόρηση και παραπληροφόρηση

Όπως οι άνθρωποι, το AI δεν είναι τέλειο. Οι απαντήσεις της τεχνητής νοημοσύνης σε προτροπές μπορεί να είναι ανακριβείς και υπάρχουν φόβοι ότι οι άνθρωποι διαδίδουν παραπληροφόρηση με κακόβουλη πρόθεση. Μαζί με τις απειλές παραπληροφόρησης, υπάρχει πιθανότητα κρίσης επωνυμίας και ζημιάς στη φήμη, ειδικά χωρίς τις κατάλληλες διασφαλίσεις και πρωτόκολλα.

Ζητήματα πνευματικής ιδιοκτησίας και πνευματικών δικαιωμάτων

Πιθανότατα έχετε δει το καστ του Χάρι Πότερ ως χαρακτήρες σε μια ταινία του Γουές Άντερσον ή τους πολίτες του Μπικίνι Μπότομ να τραγουδούν διασκευές δημοφιλών τραγουδιών. Αυτά είναι παραδείγματα του πόσοι χρησιμοποιούν την τεχνητή νοημοσύνη για να χρησιμοποιήσουν την εικόνα και την ομοιότητα ή την πνευματική ιδιοκτησία των ανθρώπων.

Η τεχνητή νοημοσύνη είναι ένας εξαιρετικός συνεργάτης για δημιουργικές εργασίες, όπως ο καταιγισμός ιδεών και η δημιουργία περιγραμμάτων, αλλά ανάλογα με τον τρόπο χρήσης των αποτελεσμάτων, θα μπορούσε να οδηγήσει σε παραβίαση πνευματικών δικαιωμάτων, λογοκλοπή και παραβιάσεις πνευματικής ιδιοκτησίας. Για παράδειγμα, μια ομάδα καλλιτεχνών υπέβαλε μήνυση εναντίον του Midjourney και του Stability AI τον Ιανουάριο του 2023, ισχυριζόμενοι ότι τα εργαλεία παραβιάζουν τα δικαιώματα εκατομμυρίων καλλιτεχνών. Το Generative AI ανοίγει ένα νόμιμο κουτί σκουληκιών και υπάρχει ακόμα πολύ έδαφος για κάλυψη, αλλά η δημιουργία προληπτικών κανόνων και πλαισίων θα βοηθήσει στον μετριασμό των ηθικών κινδύνων.

5 βήματα για να διατηρήσετε την ηθική της AI μέσα στις ομάδες

Ακολουθούν πέντε βήματα που θα σας βοηθήσουν να καθοδηγήσετε το σχέδιό σας για τον μετριασμό των ηθικών κινδύνων της τεχνητής νοημοσύνης:

αριθμός 1212 έννοια

1. Θέστε εσωτερικούς βασικούς κανόνες και ευθύνες για τη χρήση της τεχνητής νοημοσύνης

Σκεφτείτε το ενδεχόμενο να δημιουργήσετε μια ομάδα ηθικής τεχνητής νοημοσύνης αποτελούμενη από ειδικούς δεοντολογίας, νομικούς εμπειρογνώμονες, τεχνολόγους και ηγέτες που θα σας βοηθήσουν να δημιουργήσετε βασικούς κανόνες για τον οργανισμό σας. Για παράδειγμα, μόνο η χρήση γενετικής τεχνητής νοημοσύνης για προσχέδια και καταιγισμός ιδεών, αλλά όχι για εξωτερικά δημοσιευμένο περιεχόμενο είναι ένας εξαιρετικός βασικός κανόνας.

Μαζί με αυτούς τους βασικούς κανόνες, ορίστε τον ρόλο και τις ευθύνες κάθε μέλους της ομάδας που εμπλέκεται στην τεχνητή νοημοσύνη, συμπεριλαμβανομένης της ομάδας δεοντολογίας. Ορίστε τους στόχους και τις αξίες σας και για την τεχνητή νοημοσύνη. Αυτό θα σας βοηθήσει να θέσετε τα θεμέλια για την πολιτική δεοντολογίας και τις βέλτιστες πρακτικές σας για την τεχνητή νοημοσύνη.

2. Καθορίστε και ελέγξτε τον ρόλο της τεχνητής νοημοσύνης

Η τεχνητή νοημοσύνη δεν μπορεί να αντικαταστήσει τους δημιουργούς περιεχομένου, τους υπεύθυνους στρατηγικής μέσων κοινωνικής δικτύωσης ή πραγματικά κανέναν ρόλο στο μάρκετινγκ. Προσδιορίστε τα καθήκοντα τεχνητής νοημοσύνης που απαιτούν ανθρώπινη επίβλεψη ή παρέμβαση και προσδιορίστε τους στόχους της πολιτικής σας για την ηθική της τεχνητής νοημοσύνης για να βοηθήσετε στη δημιουργία διαδικασιών για την ανάπτυξη, τη διαχείριση και την επικοινωνία σχετικά με την τεχνητή νοημοσύνη.

Μόλις προσδιορίσετε τους στόχους της πολιτικής δεοντολογίας σας, εντοπίστε κενά και ευκαιρίες για την τεχνητή νοημοσύνη στον οργανισμό σας. Σκεφτείτε τις ακόλουθες ερωτήσεις:

- Πώς χρησιμοποιεί ο οργανισμός αυτήν τη στιγμή την τεχνητή νοημοσύνη και πώς θέλουμε να τη χρησιμοποιήσουμε στο μέλλον;

- Ποιο λογισμικό και ανάλυση μπορεί να μας βοηθήσει να μετριάζουμε τους επιχειρηματικούς κινδύνους;

- Ποια κενά δημιουργεί η τεχνολογία και η ανάλυση; Πώς τα γεμίζουμε;

- Τι δοκιμές ή πειράματα πρέπει να κάνουμε;

- Ποιες υπάρχουσες λύσεις μπορούμε να χρησιμοποιήσουμε με τις τρέχουσες βέλτιστες πρακτικές για τις ομάδες προϊόντων μας;

- Πώς θα χρησιμοποιήσετε δεδομένα και insights;

- Πώς θα καθιερώσουμε τη θέση της επωνυμίας μας και την ανταλλαγή μηνυμάτων για τεχνολογίες και ηθική τεχνητή νοημοσύνη;

3. Αναπτύξτε μια αεροστεγή διαδικασία αξιολόγησης πωλητή

Συνεργαστείτε με τις IT και τις νομικές ομάδες σας για να ελέγξετε σωστά τυχόν εργαλεία με δυνατότητες τεχνητής νοημοσύνης και να δημιουργήσετε μια διαδικασία ηθικού κινδύνου. Η τεχνογνωσία τους θα σας βοηθήσει να αξιολογήσετε νέες εκτιμήσεις, όπως το σύνολο δεδομένων στο οποίο έχει εκπαιδευτεί ένα εργαλείο και τα στοιχεία ελέγχου που διαθέτουν οι πωλητές για να μετριάσουν την προκατάληψη της τεχνητής νοημοσύνης. Μια διαδικασία δέουσας επιμέλειας για κάθε εργαλείο πριν από την κυκλοφορία εξωτερικά ή εσωτερικά θα σας βοηθήσει να μετριάζετε τους μελλοντικούς κινδύνους.

4. Διατηρήστε τη διαφάνεια με τις γνωστοποιήσεις

Συνεργαστείτε με τις νομικές ομάδες ή/και τις ομάδες απορρήτου σας για να αναπτύξετε εξωτερικά μηνύματα ή/και δηλώσεις αποποίησης ευθύνης για να υποδείξετε πού και πότε η επωνυμία σας βασίζεται στην τεχνητή νοημοσύνη. Αυτά τα μηνύματα μπορούν να χρησιμοποιηθούν για περιεχόμενο, εξυπηρέτηση πελατών κ.λπ. Για παράδειγμα, το TikTok ενημέρωσε τα μηνύματα τους κοινοτικές οδηγίες να απαιτείται από τους δημιουργούς να επισημαίνουν περιεχόμενο που δημιουργείται από τεχνητή νοημοσύνη. Η κοινοποίηση των δεοντολογικών σας προτύπων και πλαισίων για την υπεράσπιση της ηθικής της τεχνητής νοημοσύνης θα σας βοηθήσει να κερδίσετε την εμπιστοσύνη των ομοτίμων, των υποψήφιων πελατών και των πελατών.

1115 αριθμός αγγέλου

5. Συνεχίστε την εκπαίδευση μεταξύ ηγεσίας και ομάδων

Το AI δεν είναι κάτι επιχειρηματική ηγεσία μπορεί να βιαστεί. Όπως κάθε νέο κύμα αναδυόμενης καινοτομίας, θα υπάρχει μια καμπύλη μάθησης, πάνω από τα νέα τεχνολογικά ορόσημα. Βοηθήστε να εξισορροπήσετε τους όρους ανταγωνισμού φιλοξενώντας εσωτερικές εκπαιδεύσεις και εργαστήρια για να εκπαιδεύσετε όλα τα μέλη της ομάδας, τους ηγέτες και τους ενδιαφερόμενους σχετικά με την ηθική της τεχνητής νοημοσύνης και πώς να την χτίσετε με υπευθυνότητα.

Κάντε το σωστό με την ηθική της τεχνητής νοημοσύνης

Το να λαμβάνεται υπόψη η ηθική δεν είναι απλώς το σωστό - είναι ένα κρίσιμο στοιχείο της μόχλευσης της τεχνολογίας AI στην επιχείρηση.

Μάθετε περισσότερες προοπτικές από ηγέτες και επαγγελματίες του μάρκετινγκ σχετικά με τον τρόπο με τον οποίο η τεχνητή νοημοσύνη θα επηρεάσει το μέλλον των κοινωνικών δικτύων μας διαδικτυακό σεμινάριο, μαζί με άλλα ευρήματα από την Έκθεση για την κατάσταση των μέσων κοινωνικής δικτύωσης 2023 και συμβουλές για τη δημιουργία αποτελεσματικού κοινωνικού περιεχομένου.

Μοιράσου Το Με Τους Φίλους Σου:

![Μια απάντηση χρήστη σε μια φωτογραφία της '#SouthSudan Barbie' που δημιουργήθηκε από την τεχνητή νοημοσύνη σε ένα νήμα στο Twitter[μεταονομάστηκε σε X από τον Ιούλιο του 2023]. Η ανάρτηση αναφέρει: «Σας λέμε συνέχεια'all that bias is built into this AI-generated garbage."](https://clarksbarandrestaurant.com/img/all-marketing-insights/C2/ai-ethics-how-marketers-should-embrace-innovation-responsibly-3.png)